让 DeepSeek 替你刷网页:零代码把全网热点自动写入飞书文档

- 2026-05-08 22:37:06

在 AI 时代,最大的信息差,不再是获取信息的快慢,而是处理信息的手段。

当你还在几十个网页和论坛间穿梭,靠“人肉复制、粘贴、调格式”来收集行业动态时,真正的高效工作者,已经让 AI 接管了数据收集的全部流程。

今天,我们公开分享一套内部使用的自动化工作流。不用敲一行代码,让 AI 7×24 小时替你盯盘刷网页,并把清洗后的数据全自动归档入飞书表格。(文末附工作流源码获取方式,或后台回复【飞书】直接领取)

01. 架构分析:你的 24 小时私人情报站

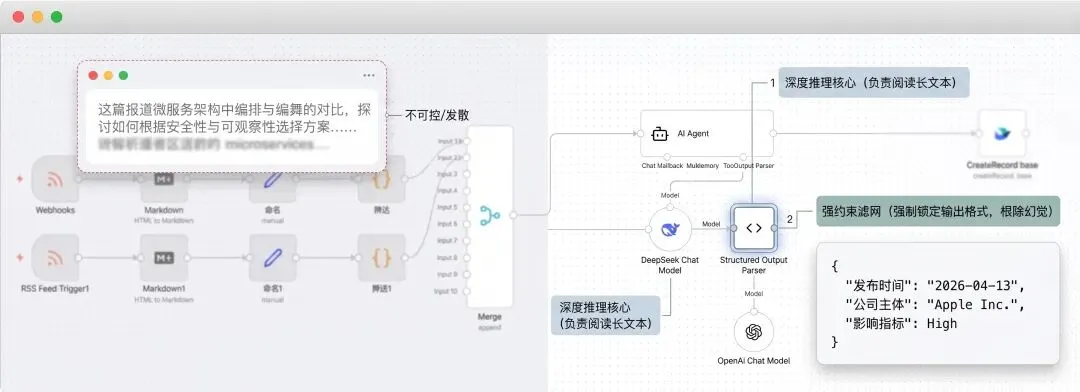

用大白话来说,这套结合了 n8n 与 DeepSeek 的自动化工作流,可以替你干三件事:

全天候盯网页数据 -> AI 分析提纯信息 ->自动把表格填好。

过去你需要每天挨个打开网页复制粘贴“信息”。现在,你只需把关注的智库网页、行业论坛、竞品官网的 RSS 链接填入工作流。

只要源头一发新文章,“工作流”就会瞬间激活,第一时间把网页里的纯净文字提取出来,并自动过滤掉烦人的广告和乱码。

把长文章扔给 AI 去做分析,最怕它发散闲聊、胡编乱造。为了根除 AI 的“幻觉”,我们给 DeepSeek 套上了结构化输出解析器。

在这个节点的约束下,AI 必须老老实实按照你设定的格子(如:发布时间、核心事件、影响指标),把核心干货精准地“抠”出来。

最后,被洗得干干净净、结构分明的数据,会全自动、整整齐齐地写入你的飞书多维表格。

从源头网页更新,到你的飞书里多出一行完美的结构化数据,全程不到 10 秒钟。 哪怕你晚上还在梦乡,工作流就已经替你完成了整夜的数据收集与排版。

02. 进阶玩法:飞书对接 AI 的自动化量化分析

如果说全自动收集数据只是“搬砖”,那么真正产生商业价值的,是从这些数据中淘出“黄金”。

比如设定在每天下午 5 点下班前:

系统会自动读取飞书里今天抓取的所有行业动态,然后把这堆海量数据打包,整体丢给 DeepSeek 进行一次深度的“复盘”。

它能自动统计核心热词、评估行业情绪走向,并为你提炼出最具潜力的趋势研判,最后将这份极度浓缩的情报日报推送到你的飞书群或者邮件中。 相当于免费雇了一位不知疲倦的量化分析师。

03. 案例演示:系统实际跑出来的样子

空谈逻辑不如看实际效果。

下方这张图,是我们利用该工作流,在 4 月 9 日自动生成的【情报实录】。

左侧(信息清洗):DeepSeek 自动剔除外文冗余,提取业务核心(高亮处),彻底免除长文阅读负担。

右侧(结构化归档): 提纯数据秒级写入飞书,【时间】与【信源】自动对齐,构建严谨的数据矩阵。

中枢(全景可视化): 依托规整矩阵,工作流直接调用 JS 渲染,实时生成分类饼图与柱状图等数据看板。

这套工作流的核心定位,是提供纯粹的客观数据整理与效率辅助,让你时时刻刻都能直观地看到 AI 为你梳理好的关键行业动态,清清楚楚、分门别类。

04. 源码获取 (Open Source)

为了让大家零距离体验自动化的效率,我们将这套基础版工作流的核心源码进行了公开分享。

整个部署过程无需敲击任何代码,直接导入即可在本地跑通你的第一个自动化情报系统。

✅ 完整工作流源码.json (零代码,一键导入)

✅ 结构化强约束 Prompt 逻辑 (让 AI 精准听话的秘诀)

✅ 基础配置与飞书鉴权指南